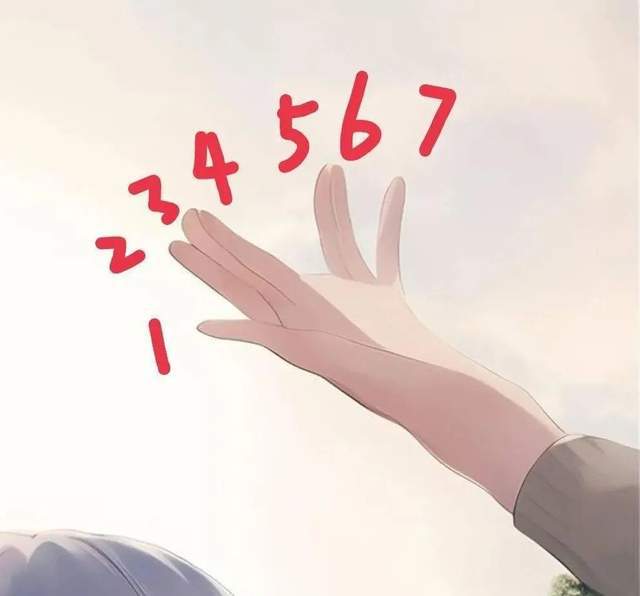

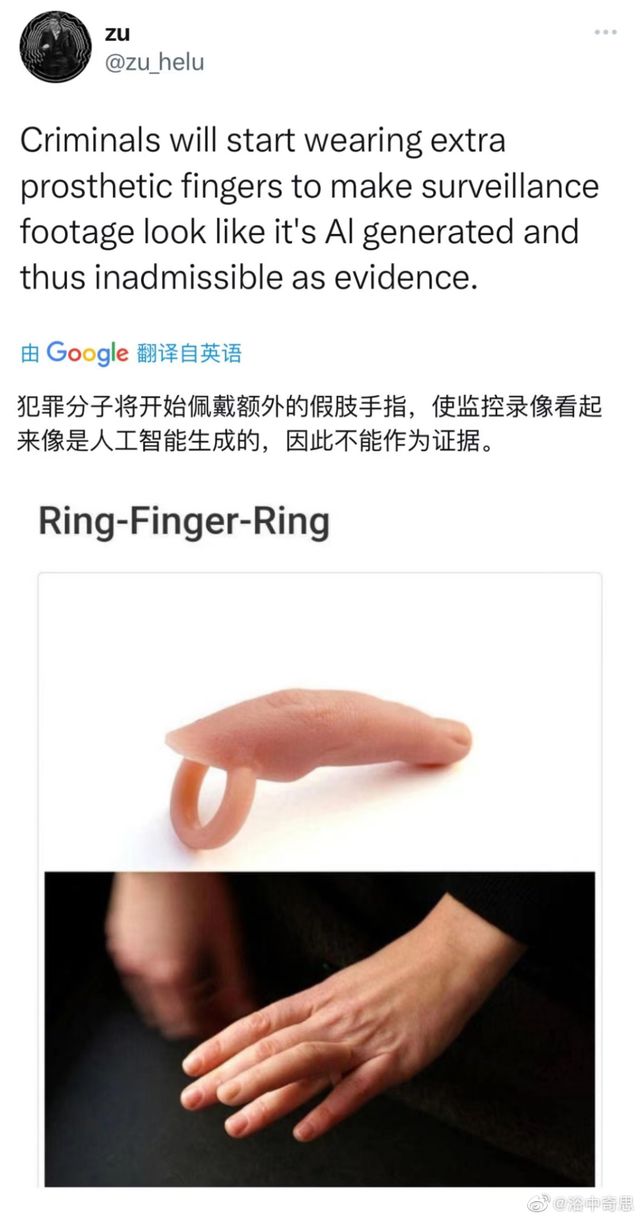

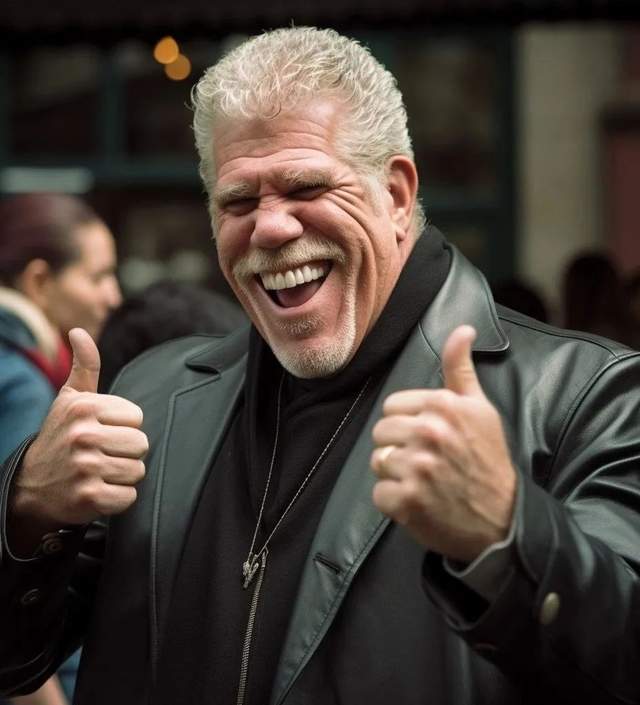

估计很多多少人早就听说过 AI 画手“ 不会画手 ” 的笑话了。 细数起来, AI 在这上头翻的车,那但是掰动手指头都数不外来:    以至于有人说, “ 怎么辨别这是不是 AI 画的?看手就行了 ” 。 更有甚者,开了一个很大的脑洞:如果我带上 “ 假手指 ” 再干坏事,是不是就可以一口咬定监控是 AI 天生,从而逃走罪责了?  要是在从前,用这个办法说不定真就能蒙混已往。 但如今想钻这个毛病的人,可以洗洗睡了。 由于就在不久前, Midjourney 公布的第五代版本—— Midjourney V5 ,已经能画出正常的手了。  看到 Midjourney 这个名字,是不是有人以为眼熟?没错,它就是谁人客岁画出《 太空歌剧院 》,在美术比赛拿了一等奖的 AI 绘画平台。 Midjourney 把消息放出来后,很多多少人都不由得去试了一把,用完发现它 “ 诚不欺我 ” ,画出来的人手果然正常了:   对比一下,之前它画出的人的手,是这个样子:  以是曾经的它,到底对手指有什么误解啊。。。 而现在Midjourney 能搞定手的困难,一个紧张缘故原由就是它有了很多多少关于手的数据。 AI 能画画,离不开数据。但现有的图片里,能露脱手的可不多( 相对像人脸如许部位来说 ),再加上人的手非常机动,能有许多种差别的姿势。 指望 AI 本身能学会辨认,那真是为难它了。 之前要想让 AI 画出像样的手,要么是平台专门雇人给图片里的人手打上标志,像把手掌、拇指、食指啥的,都给清晰地标出来;  要么就得用户费点心,在输入提示词的时间,说得具体一点。有人曾经在用上百个字的提示词,让 AI 乐成画出一点弊端都没有的手:  可这种办法显然不得当大多数用户,且不说有没有这个耐烦,就是知道该输入哪些提示词这事,恐怕都得有点专业配景才行。 而 Midjourney 这次升级的新版本,使用了社区里那些专业老哥反馈的海量手部数据,迭代了一波,从而能画出正常的手。 除了能画出正常的手,这次推出的第 5 版,另有其他方面的升级。 比方,最让 Midjourney 自得的,是 V5 对光线、人物心情如许的细节处置惩罚得更好了,能让天生图片更加传神。 此前 Midjourney 最擅永生成的,都是理想风格的,纵然让它画实际的东西,也会透出一丝丝的不真实。  而如今的 V5 ,画得就非常写实了,像下面这张,你要是不说是 AI 画的,我真会信赖是照相机拍出来的。。。  难怪国外有个叫 Julie Wieland 的平面计划师,会给出如许的评价: “MJ v5 就像给近视患者戴上眼镜,结果清楚, 4K 细节拉满,太不可思议了 ” 。 别的, V5 对输入的提示明白本领更强,输出的图片也更有创意。 如果你输入 “ 一个肌肉发达的野生番,在 CRT 电视机旁边拿着武器、影戏、 8K 、演播室照明 ” ,那么 Midjourney V3 ( 左 )、 V4 ( 中 )和 V5 ( 右 )分别会天生如下的图片:  另有一个功能,网上提到的不多,但我以为非常有效,那就是它能反向操纵,从 “ 图像到文本 ” 。 你可以上传一张图片,然后它就能告诉你,要想天生这个图像,该输入哪些提示词。 举个例子,假如你上传一张埃菲尔铁塔的照片,它就会告诉你,这张图片的提示词是 “ 位于巴黎的倒金字塔外形的大型金属布局 ” 。 有了这个功能,你就能知道 AI 是咋想的,下次你再想让它天生你必要的图片时,就能省不少劲。  而除了 Midjourney 之外,近来另一家在 AI 绘画行业呼风唤雨的平台—— Stable Diffusion ,实在也有新动作了。 他们推出了 Stable Diffusion Reimagine ,这玩意可以用图来天生图。 据 Stability AI 说,这个工具的利用体验非常友爱,不必要输入任何提示词,只要一键上传图片,它会遐想、重新创作 3 张差别的照片。 他们展示了一个案例,给它上传一张寝室装修的图片,它主动天生了 3 张风格、位置各不雷同的图片。  你要是不满足,可以点击图片的重置按钮, 2 秒钟就能完成图片的再次天生,只要你乐意可以无穷重置下去。 对于这么好玩的功能,网友们固然不会放过。 一个日本网友上传了一张二次元妹子的图片, Reimagine 立刻返给了他三张:  我也试了一下,上传了暖锅的照片,效果是如许的:  但感觉天生的图片一点都不像暖锅。。。 我这还算好的,有人上传了非高清图片,发现它天生的图片非常感人,像下面这个就是:  还真是 Reimagine ( 重新想象 )啊。。。 Stability.AI 倒也坦然,他们大方认可,这项天生式 AI 技能 “ 可以根据某些图像引发惊人的效果,而对其他图像产生不太令人印象深刻的效果 ” 。 用人话说就是 Stable Diffusion Reimagine 的画画程度相称不稳固,偶然画出来的东西让人惊艳,偶然画得就很拉胯。 就像段誉一样,时灵时不灵。。。  对于这点,有人分析,这和 Stability AI 在模子中安装了一个过滤器有关。 这个过滤器是用来制止不得当的哀求,但过滤器偶然会把正常的哀求误以为有题目,导致输出的效果特别古怪。 只管云云,照旧得认可, Stable Diffusion 这个技能确实很牛,有开创性。 由于它是用图像编码器更换了原始文本编码器,换句话说,就是 Reimagine 会把你上传的原图完全编码,再用算法生玉成新的图,这意味着它根本没用原图的任何一个像素。 就冲下面这张图,这话我信。。。  看完这些,我不得不感叹,技能的进步速率着实是快。 就在不久前,不少人还在讽刺 AI 绘画连手都画不明确,代替人类画师根本就是痴心贪图。 没想到, AI 这么快就把短板补上来了,虽说它另有许多不完善的地方,但谁敢小瞧它将来的发展呢。 如今,我莫名地等待 OpenAI 旗下的 DALL-E 2 的新消息了,真不知道它要是和 GPT-4 双剑合璧,会带来啥新格式。  |